telegeram安卓下载

包含tokenizer分词器的词条

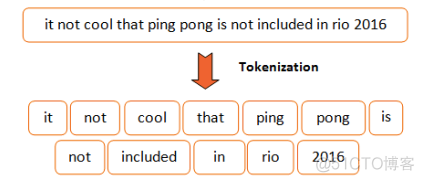

1、这些算法称为 Tokenizer分词器 , 这些Token会被进一步处理, 比如转成小写等, 这些处理算法被称为 Token Filter词元处理器 ,被。

2、Character Filters字符过滤器接收原始文本text的字符流,可以对原始文本增加删除字段或者对字符做转换 一个Analyzer 分析器可以有 0n 个按顺序执行的字符过滤器Tokenizer Tokenizer 分词器接收Character Filters输出的字符。

3、HCT也是一个通用的中文分词工具HCT全称为HanLP Common Tokenizer,是由一套基础分词算法组成的通用中文分词工具高效采用Java8函数式编程风格实现,多核支持,秒级别性能精准中文分词采用bigram隐马模型,实体名词识别。

4、本节课主要涉及词法分析,将一段话使用分词器tokenizer 进行分词,关键是怎么分词分词的规则是啥一般我们会联想到正则文法进行匹配 如果正则满足不了呢等等一系列的问题在分词过程中我们需要有一个数学模型有限自动。

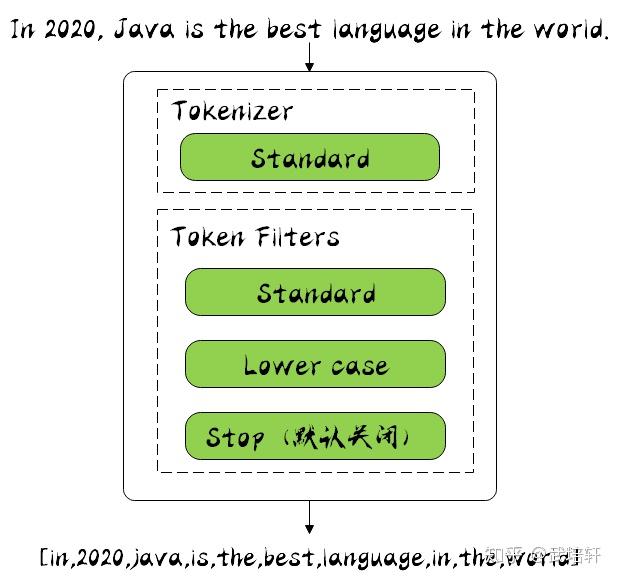

5、在Lucene中,一个标准的分析器Analyzer由两部分组成,一部分是分词器,被称为Tokenizer另一部分是过滤器,被称为TokenFilter一个分析器Analyzer往往由一个分词器和多个过滤器组成这里所说的过滤器,和检索时用的过滤器。

6、5 jieblcut 以及 jiebalcut_for_search 直接返回list 6 jiebaTokenizerdictionary=DEFUALT_DICT 新建自定义分词器,可用于同时使用不同字典,jiebadt为默认分词器,所有全局分词相关函数都是该分词器的映射。

7、Elasticsearch全文检索默认分词器为standard analyzerstandard analyzer中,character Filter什么也没有做,Token Filters只是把英文大写转化为小写,因此Elasticsearch默认对大小写不敏感,下面主要介绍Tokenizer token分隔符把text。

8、到此为止一个新的类型的分词器就定义好了,接下来就是要如何使用了或者按如下配置curl XPUT localhost9200indexname d #39 quotsettingsquot quotanalysisquot quotanalyzerquot quotikquot quottokenizerquot quotikquot 。

相关文章

发表评论

评论列表

- 这篇文章还没有收到评论,赶紧来抢沙发吧~